Что делать распознавание речи поддерживается. Распознавание речи с применением настольных.NET-приложений. Управление компьютером с помощью распознавания речи

Операционная система Windows 7 оснащена многими опциями, которые дают все больше возможностей пользователям данной системы. В нее смогли внедрить весьма интересную функцию, которая носит название «распознование речи». Но что представляет собой данная система? Об этом и пойдет разговор.

Опция, о которой идет речь, позволяет применять в приложениях всей системы абсолютно новый способ взаимодействия пользователя с компьютером. Именно система «Распознавание речи Windows 7» допускает возможность управления компьютером, не используя при этом клавиатуру, мышь и другие средства.

Хочется отметить, что данная инновация будет доступна и в других продуктах Microsoft. Эта функция была замечена немного ранее, то есть ее попытались внедрить в Windows Vista, но в седьмой версии операционной системы компании Microsoft голосовое управление выполнено на более высоком уровне по сравнению с предшественником. Если сказать проще, такая опция, как распознавание речи Windows 7 стала еще более функциональной.

Кроме всего сказанного, хочется отметить, что она имеет довольно широкий спектр применения. Пользователи Windows 7 с функцией распознания речи имеют возможность запускать программы и конвертировать все звуковые фрагменты в текст, выполнять всевозможные команды на компьютере, используя всего лишь свой голос и необходимые приспособления. Но что же нужно для того, чтобы распознавание речи Windows 7 стало реальным?

В первую очередь, вам понадобится микрофон, который следует подключить к компьютеру. Кроме этого, необходимо приобрести специальное приложение или программу, которая издается самим производителем, то есть компанией Microsoft. После того как все необходимые компоненты будут установлены, а микрофон подключен к компьютеру, следует осуществить еще определенный план работы:

- Необходимо выполнить тестовые голосовые команды и конвертировать их в текст.

- После того как вы проведете обучение программы распознания, нужно будет создать шаблоны разных команд своим голосом. Именно на основе данной работы компьютер сможет принимать и выполнять все заданные вами команды.

Функция распознавание речи Windows 7 используется в текстовом редакторе компании Microsoft - WordPad. Она безотказно функционирует при заполнении различных форм, а также хорошо себя проявляет в работе в Internet Explorer и при

Кроме этого, данная опция без труда отредактирует записанный ранее текст, определив специальные голосовые команды. Конечно, в процессе распознавания той или иной задачи случаются типичные ошибки (когда происходит ошибочное распознавание некоторых звуков). На этот случай в программе предусмотрен список соответствий тех или иных слов.

Функция, конечно, феноменальная, но все же здесь есть одно «но». Все дело в том, что распознавание русской речи сейчас, в принципе, недоступно. Имеются отличные версии программы для английского, французского, немецкого и японского языка. Существуют также версии для китайской, испанской и итальянской речи.

Но вот данная новинка не совсем адаптирована для русской речи. Ваш компьютер не сможет воспринимать поставленные перед ним задачи, а значит, вам будет проще написать что-то при помощи клавиатуры или же выполнить определенные задачи с помощью мыши.

Конечно, вы можете попробовать поработать с подобными русскоязычными программами или же отдать свое предпочтение английскому языку, но все же остается надеяться, что в скором времени распознавание речи на русском языке тоже будет доступно в качественном режиме. И именно тогда вы сможете опробовать на практике такую уникальную функцию. Ведь она, без сомнения, явно упрощает работу на персональном компьютере и является огромным прорывом в сфере программирования. Так что остается лишь ждать.

Голосовой ввод текста на Андроиде – это удобно даже при обычном наборе смс, а если вам нужно набирать большие объемы текста в день или решать деловые вопросы параллельно с другими рабочими обязанностями, то эта функция станет просто незаменимой.

В ОС Андроид имеется стандартная функция диктовки слов голосом, которую можно включить в настройках, не скачивая дополнительных приложений. Система автоматически добавит значок микрофона на электронную клавиатуру, и вы сможете пользоваться ею тогда, когда вам нужно.

Если включенный ввод вам больше не нужен, и вы хотите его отключить, в этом же меню выберите кнопку «Отключить» или снимите галочку с соответствующего пункта.

Как пользоваться голосовым вводом

Как включить эту функцию, мы уже разобрались, теперь нужно понять, как ею пользоваться. Она будет доступна практически во всех меню и приложениях, в которых можно использовать электронную клавиатуру.

- Чтобы начать диктовку текста, нажмите на текстовый экран или на ту часть текста, которая уже была введена. Высветиться стандартная электронная клавиатура.

- Нажмите на значок микрофона на главном экране, или же перейдите в раскладку символов, если вы перенесли клавишу с микрофоном туда при настройке.

- На экране отобразится меню для записи вашего голоса и надпись: «Говорите». Надиктуйте нужный текст в микрофон смартфона, и он автоматически преобразует голос в текст.

Знаки пунктуации нужно проговаривать словами: «Вопросительный знак», «Запятая», «Точка». Старайтесь говорить четче, иначе программа может неправильно понять ваши слова, соответственно, преобразовать их в схожие по звучанию.

Какие настройки доступны при распознавании голоса Андроидом

Настроить работу стандартного голосового ввода на Android можно в меню «Язык и ввод», в который можно попасть через «Настройки», или же нажав на «шестеренку» настроек прямо в меню, которое высветилось после нажатия микрофона (обычно кнопка настроек находится слева от слова «Говорите»).

Настройка распознания речи. Здесь можно сделать следующее:

- Выбрать язык. Распознавание доступно и в офлайн режиме, но по умолчанию у вас будет установлен только русский язык (или же русский + английский). Для других языков функция будет работать либо только при , либо тогда, когда вы скачаете нужные языки. Скачать нужные языковые пакеты можно в меню настроек языка и ввода, нажав на «Распознавание речи офлайн».

- Настроить распознавание «О’кей Google». После настройки этого пункта, вы сможете использовать менеджер поисковой системы при открытой системе Google, только сказав: «О’кей Google». А потом надо произнести, что вам нужно найти в поисковике.

- Включить возможность управления голосом с проводной гарнитуры или Bluetooth-устройств.

- Настроить распознавание нецензурных слов. Программа автоматически включает пункт «Скрывать распознанные нецензурные слова».

- Включить или выключить озвучивание результатов в стандартном режиме или в режиме подключенной гарнитуры.

Так как я видел мой первый Sci-Fi кино фильм, я хотел бы иметь технологии которые они используют. Я до сих пор не видел летающих кораблей в таком масштабе, телепортация устройств, роботов, которые могут танцевать или других подобных устройств. Тем не менее, я нашел кусок этой мечты включенной в приложение Windows Vista - Windows Speech Recognition - Распознавание речи.

Этот инструмент пытается понять, что вы говорите и преобразует произнесенные слова в машиночитаемый ввод, такой как нажатие клавиш или Windows команды, ограничивая тем самым необходимость использования мыши и клавиатуры. В этом уроке я покажу вам, как настроить Windows Speech Recognition - Распознавание речи Windows , и научу как использовать её и дать вам некоторые сведения об общих вопросах по этому приложению. Для того чтобы использовать Windows Speech Recognition – Распознавание речи Windows вам нужен микрофон. Чтобы узнать, как настроить его, читайте статью о том, как установить и настроить микрофон в Vista.

Как установить Windows Speech Recognition

После того как вы установили свой микрофон, вfv нужно тренироваться c Распознаванием речи в Windows , чтобы понять ваш голос. Чтобы сделать это, откройте окно Control Panel – Панель управления и нажмите на – Получить доступ.

Если вы используете классическое управление Группами, перейдите в Control Panel -> Ease of Access Center – Панель управления-> Центр Специальных возможностей. Когда вы находитесь в окне Постой доступ, нажмите на Speech Recognition Options – Функции распознавания речи.

В окне Speech Recognition Options – Функции распознавания речи нажмите на Start Speech Recognition – Начать Распознавание речи.

Появится Мастер установки. Чтобы начать настройку, нажмите на кнопку Next – Следующий.

Выберите устройства микрофон, которые в настоящее время используются и нажмите на кнопку Next – Следующая.

Если следовать данным указаниям, они дадут вам лучший результат. В моем случае, так как я выбрал микрофон с гарнитурой, указания были, как показано ниже. После прочтения и после данной консультации, нажмите кнопку Next – Следующая.

Примечание: Если вы случайно выбрали неверное устройство или вы просто хотите, чтобы вернуться к предыдущей странице Настройка, нажмите на синюю стрелку Back – назад в левом верхнем углу окна мастера установки.

Прочитайте текст вслух, после чего нажмите кнопку Next- Следующая.

Эта процедура, может быть немного с ошибками, поэтому вы можете повторить её несколько раз, и отрегулировать положение микрофона и его расстояние от динамиков.

Примечание: Если вы уже пытались несколько раз сделать настройки, и микрофон еще не работает, закройте мастер и проверьте статю о том, как установить и настроить Микрофон. Когда микрофон установлен правильно, повторите процедуру, описанную в этой статье.

Если вы читали текст и нажали кнопку Next – Далее , мастер скажет, что микрофон был установлен. Нажмите на кнопку Next - Готово .

После настройки микрофона, мастер попытается повысить точность распознавания речи. Мастер установки спросит вашего разрешения, чтобы приложение усовершенствовалось, используя тексты из документов или по почте. После того как вы выберите нужный вариант, щелкните Next - Далее .

В настоящее время мастер даст вам ссылку на карту речи, которая содержит список команд компьютера, на которые он будет отвечать. Если вы нажмете на View Reference Sheet – Показать лист ссылок , Вы можете видеть команды, а также распечатать их.

Когда закончите, нажмите кнопку Next - Далее .

Примечание: лист ссылок можно прочитать и распечатать в любое дополнительное время, просто зайдите в Access -> Speech Recognition Options -> Open the Speech Reference Card - Панель управления-> Специальные возможности-> Параметры распознавания речи-> открыть Карту ссылок речи .

Можно сделать приложение,которое запускается каждый раз при запуске Windows Vista , проверяя вариант “ Run Speech Recognition at startup – Выполнить Распознавание речи при запуске ” . Если вы оставите его без внимания, приложение нужно будет запускать каждый раз в ручную, когда вы захотите его использовать.

Узнайте, как использовать Windows Speech Recognition

Как только вы закончите с настройкой, вам будет предложено пройти урок и научиться его использовать. Нажмите на вход для входа в Учебник.

ВАЖНО: Я не могу дать вам указания о содержании учебника. Я считаю, что руководство хорошо написано и содержит всю необходимую информацию. Пожалуйста, найдите время 10-15 минут, чтобы прочитать это. Хотя это может показаться на первый взгляд разочарованием,но в итоге, вы будете довольны результатами.

Если вы закончили урок, и вы думаете, что Распознавание речи Windows

не слышит голосовые команды достаточно хорошо, Вы можете взять тот же учебник снова. Для этого перейдите в параметры

Windows Speech Recognition

– Распознавание речи

и нажмите Take Speech Tutorial

– Возьмите Учебник

речи

.

Если вы прочитали учебник, но вы все ещё чувствуете необходимость улучшения методов в работе с Распознаванием речи в Windows

, вы можете сделать еще один учебник на основе чтения текстов. Чтобы открыть и использовать текстовый учебник, нажмите ‘

Train you computer to better understand you

– Тренировка вашего компьютера, чтобы лучше понять вас ” находится в окне

параметры

Speech Recognition Options

– Распознавание речи.

Рекомендации : Пройдите уроки ‘ Train your computer to better understand you – Обучение компьютеру, чтобы лучше его понять “ несколько раз. Даже если вы делаете ошибки первые несколько раз, менее чем за 3 дня и пару часов в день, вы будете удивляться, как вы могли жить без этого приложения. Вместо того, чтобы закрыть приложение, просто нажмите остановить прослушивание или нажмите с клавиатуры Ctrl + Windows .

Известные проблемы

Некоторые приложения могут не работать с Распознаванием речи в Windows . Это потому, что приложения должны иметь поддержку текстовых служб. Структура была построена Microsoft, чтобы включить дополнительный ввод текста, распознавание речи и поддержку в приложениях. Таким образом, если разработчики не включили Text Services Framework , когда они построили их применения, Распознавание речи в Windows не будет работать должным образом с их применением.

Распознавание речи в Windows не работает, когда появится предупреждение UAC (User Account Control) . В таких случаях с помощью мыши или клавиатуры, выберите опцию UAC которую вы хотите.

Windows предоставляет функцию распознавания речи на основе устройств (доступную как с помощью приложения Windows Recech Recognition Desktop), так и с помощью облачной службой распознавания речи на тех рынках и регионах, где доступна Cortana. Microsoft может использовать голосовые данные, взаимодействия с компьютером, чтобы улучшить услуги распознавания речи.

Чтобы использовать распознавание речи, необходимо включить параметр «Знакомство с вами» (параметр конфиденциальности в разделе «Персонализация рукописного ввода и ввода с клавиатуры»), поскольку голосовые службы существуют как в облаке, так и на вашем устройстве. Информация, которую Microsoft собирает с их помощью, позволяет их улучшить. Речевые службы, которые не передаются в облако и присутствуют только на вашем устройстве, такие как «Диктор» и «Распознавание речи Windows», по-прежнему будут работать, если этот параметр отключен, но Microsoft уже не будет собирать данные.

Если для параметра «Диагностика и использование данных» («Параметры» → «Конфиденциальность» → «Диагностика и отзывы») установлено значение «Полные», входящие данные для рукописного ввода и ввода текста отправляются в Microsoft, и компания использует эти данные в совокупности, чтобы улучшить платформу для всех пользователей.

Чтобы отключить распознавание голоса в Windows 10, выполните следующие действия.

- Откройте приложение «Параметры» .

- Перейдите в раздел «Конфиденциальность» → «Голосовые функции» .

- Справа отключите опцию «Распознавания голоса в сети» передвинув ползунок переключателя в положение «Откл.» .

Теперь функция отключена.

Кроме того, вы можете применить настройки реестра.

Отключить распознавание речи в сети с помощью настройки реестра.

- Загрузите следующий ZIP-архив: загрузите ZIP-архив .

- Извлеките его содержимое в любую папку. Вы можете разместить файлы непосредственно на рабочем столе.

- Дважды кликните файл Off-Online Recognition.reg , чтобы начать процесс слияния.

Чтобы отменить изменение при необходимости, используйте файл On-Online Speech Recognition.reg .

Файлы реестра, выше, изменяют ветвь реестра

HKEY_CURRENT_USER\Software\Microsoft\Speech_OneCore\Settings\OnlineSpeechPrivacy

Они изменяют параметр DWORD (32 бита) с именем HasAccepted .

- HasAccepted = 1 - Включить распознавание речи в сети.

- HasAccepted = 0 - Функция распознавания речи отключена.

Кроме того, начиная с Windows 10 build 17063, ОС имеет ряд новых параметров в разделе «Конфиденциальность». К ним относятся возможность управления разрешениями на использование для ваших библиотек / папок, микрофона, календаря, информации учетной записи пользователя, файловой системы, местоположения, контактов, истории вызовов, электронной почты, обмена сообщениями и т. Д.

Наконец, вы можете отключить распознавание речи в сети на странице конфиденциальности программы установки Windows во время установки ОС с нуля.

Продукты и технологии:

Visual Studio, C#, .NET Speech Libraries

В статье рассматриваются:

- добавление поддержки распознавания речи к консольному приложению;

- обработка распознаваемой речи;

- установка библиотек для распознавания речи;

- сравнение Microsoft.Speech и System.Speech;

- добавление поддержки распознавания речи к приложению Windows Forms.

С появлением Windows Phone Cortana, персонального помощника, активируемого речью (равно как и аналога от фруктовой компании, о котором нельзя упоминать всуе), приложения с поддержкой речи стали занимать все более значимое место в разработке ПО. В этой статье я покажу, как начать работу с распознаванием и синтезом речи в консольных Windows-приложениях, приложениях Windows Forms и Windows Presentation Foundation (WPF).

Заметьте, что также можете добавить речевые возможности в приложения Windows Phone, веб-приложения ASP.NET, приложения Windows Store, Windows RT и Xbox Kinect, но соответствующие методики отличаются от рассматриваемых в этой статье.

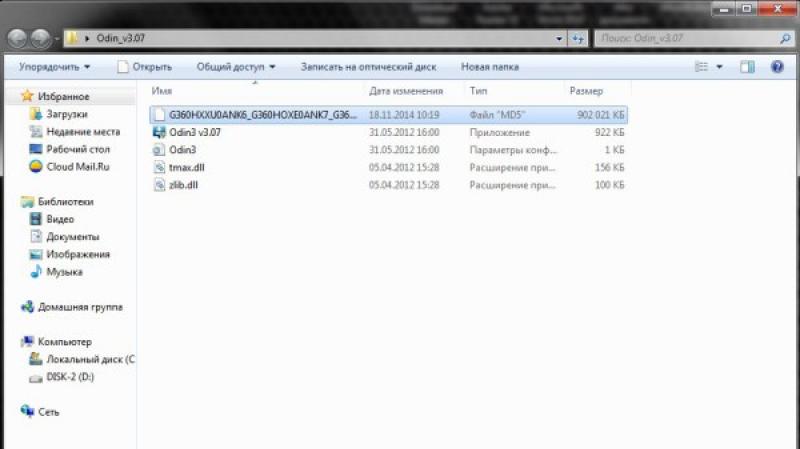

Хороший способ понять, что именно будет обсуждаться в этой статье, - взглянуть на экранные снимки двух разных демонстрационных программ на рис. 1 и 2 . После запуска консольное приложение на рис. 1 немедленно произносит фразу «I am awake». Конечно, вы не сможете услышать демонстрационное приложение, читая эту статью, поэтому оно отображает текст того, что говорит компьютер. Потом пользователь произносит команду «Speech on». Демонстрационное приложение откликается распознанным текстом, а затем на внутреннем уровне включает прослушивание и реагирует на запросы сложить два числа.

Рис. 1. Распознавание и синтез речи в консольном приложении

Рис. 2. Распознавание речи в приложении Windows Forms

Пользователь попросил приложение сложит один и два, затем два и три. Приложение распознало произнесенные команды и дало ответы голосовым способом. Позднее я опишу более полезные способы применения распознавания речи.

Далее пользователь сказал «Speech off» - голосовую команду, которая деактивирует прослушивание команд для сложения чисел, но не отключает полностью распознавание речи. После этой речевой команды следующая команда на сложение единицы с двойкой была проигнорирована. Наконец, пользователь снова включил прослушивание команд и произнес бессмысленную команду «Klatu barada nikto», которую приложение распознало как команду на полную деактивацию распознавания речи и свое завершение.

На рис. 2 показано приложение Windows Forms с включенным холостым распознаванием речи (dummy speech-enabled). Это приложение распознает произносимые команды, но не реагирует на них голосовым выводом. При первом запуске приложения флажок Speech On не был установлен, указывая на то, что распознавание речи не активно. Пользователь установил этот флажок, а затем произнес «Hello». Приложение откликнулось выводом распознанного текста в элементе управления ListBox в нижней части окна.

Затем пользователь произнес: «Set text box 1 to red». Приложение распознало речь и откликнулось: «Set text box 1 red», что почти (но не совсем) точно соответствует тому, что сказал пользователь. Хотя на рис. 2 этого не видно, текст в элементе управления TextBox в верхней части окна стал действительно красным.

Потом пользователь произнес: «Please set text box 1 to white». Приложение распознало это как «set text box 1 white» и сделало именно это. В заключение пользователь сказал: «Good-bye», и приложение вывело этот текст, но ничего не стало делать с Windows Forms, хотя могло бы, например, сбросить флажок Speech On.

Использовать объект синтезатора довольно просто.

В следующих разделах я пройду вместе с вами по процессу создания обеих демонстрационных программ, включая установку необходимых речевых.NET-библиотек. В этой статье предполагается, что вы владеете навыками программирования хотя бы на среднем уровне, но ничего не знаете о распознавании и синтезе речи.

Добавление поддержки распознавания речи в консольное приложение

Чтобы создать демонстрацию, показанную на рис. 1 , я запустил Visual Studio и создал новое консольное приложение на C# с названием ConsoleSpeech. Я успешно использовал речевые средства с Visual Studio 2010 и 2012, но должна подойти любая сравнительно недавняя версия. После загрузки кода шаблона в редактор я переименовал файл Program.cs в окне Solution Explorer в более описательный ConsoleSpeechProgram.cs, и Visual Studio переименовала класс Program за меня.

Далее я добавил ссылку на файл Microsoft.Speech.dll, который находится в C:\ProgramFiles (x86)\Microsoft SDKs\Speech\v11.0\Assembly. Эта DLL отсутствовала на моем компьютере, и мне пришлось скачивать ее. Установка файлов, необходимых для добавления распознавания и синтеза речи в приложение, не столь уж и тривиальна. Я подробно объясню процесс установки в следующем разделе, а пока допустим, что Microsoft.Speech.dll есть в вашей системе.

Добавив ссылку на речевую DLL, я удалил из верхней части кода все выражения using, кроме указывавшего на пространство имен System верхнего уровня. Потом я добавил выражения using для пространств имен Microsoft.Speech.Recognition, Microsoft.Speech.Synthesis и System.Globalization. Первые два пространства имен сопоставлены с речевой DLL. Заметьте: существуют и такие пространства имен, как System.Speech.Recognition и System.Speech.Synthesis, что может сбить с толку. Вскоре я поясню разницу между ними. Пространство имен Globalization было доступно по умолчанию и не требовало добавления новой ссылки в проект.

Весь исходный код демонстрационного консольного приложения приведен на рис. 3 , а также доступен в пакете исходного кода, сопутствующем этой статье. Я убрал всю стандартную обработку ошибок, чтобы по возможности не затуманивать главные идеи.

Рис. 3. Исходный код демонстрационного консольного приложения

using System; using Microsoft.Speech.Recognition; using Microsoft.Speech.Synthesis; using System.Globalization; namespace ConsoleSpeech { class ConsoleSpeechProgram { static SpeechSynthesizer ss = new SpeechSynthesizer(); static SpeechRecognitionEngine sre; static bool done = false; static bool speechOn = true; static void Main(string args) { try { ss.SetOutputToDefaultAudioDevice(); Console.WriteLine("\n(Speaking: I am awake)"); ss.Speak("I am awake"); CultureInfo ci = new CultureInfo("en-us"); sre = new SpeechRecognitionEngine(ci); sre.SetInputToDefaultAudioDevice(); sre.SpeechRecognized += sre_SpeechRecognized; Choices ch_StartStopCommands = new Choices(); ch_StartStopCommands.Add("speech on"); ch_StartStopCommands.Add("speech off"); ch_StartStopCommands.Add("klatu barada nikto"); GrammarBuilder gb_StartStop = new GrammarBuilder(); gb_StartStop.Append(ch_StartStopCommands); Grammar g_StartStop = new Grammar(gb_StartStop); Choices ch_Numbers = new Choices(); ch_Numbers.Add("1"); ch_Numbers.Add("2"); ch_Numbers.Add("3"); ch_Numbers.Add("4"); GrammarBuilder gb_WhatIsXplusY = new GrammarBuilder(); gb_WhatIsXplusY.Append("What is"); gb_WhatIsXplusY.Append(ch_Numbers); gb_WhatIsXplusY.Append("plus"); gb_WhatIsXplusY.Append(ch_Numbers); Grammar g_WhatIsXplusY = new Grammar(gb_WhatIsXplusY); sre.LoadGrammarAsync(g_StartStop); sre.LoadGrammarAsync(g_WhatIsXplusY); sre.RecognizeAsync(RecognizeMode.Multiple); while (done == false) { ; } Console.WriteLine("\nHit < enter > to close shell\n"); Console.ReadLine(); } catch (Exception ex) { Console.WriteLine(ex.Message); Console.ReadLine(); } } // Main static void sre_SpeechRecognized(object sender, SpeechRecognizedEventArgs e) { string txt = e.Result.Text; float confidence = e.Result.Confidence; Console.WriteLine("\nRecognized: " + txt); if (confidence < 0.60) return; if (txt.IndexOf("speech on") >= 0) { Console.WriteLine("Speech is now ON"); speechOn = true; } if (txt.IndexOf("speech off") >= 0) { Console.WriteLine("Speech is now OFF"); speechOn = false; } if (speechOn == false) return; if (txt.IndexOf("klatu") >= 0 && txt.IndexOf("barada") >= 0) { ((SpeechRecognitionEngine)sender). RecognizeAsyncCancel(); done = true; Console.WriteLine("(Speaking: Farewell)"); ss.Speak("Farewell"); } if (txt.IndexOf("What") >= 0 && txt.IndexOf("plus") >= 0) { string words = txt.Split(" "); int num1 = int.Parse(words); int num2 = int.Parse(words); int sum = num1 + num2; Console.WriteLine("(Speaking: " + words + " plus " + words + " equals " + sum + ")"); ss.SpeakAsync(words + " plus " + words + " equals " + sum); } } // sre_SpeechRecognized } // Program } // ns

После выражений using демонстрационный код начинается так:

namespace ConsoleSpeech { class ConsoleSpeechProgram { static SpeechSynthesizer ss = new SpeechSynthesizer(); static SpeechRecognitionEngine sre; static bool done = false; static bool speechOn = true; static void Main(string args) { ...

Объект SpeechSynthesizer на уровне класса дает возможность приложению синтезировать речь. Объект SpeechRecognitionEngine позволяет приложению прослушивать и распознавать произносимые слова или фразы. Булева переменная done определяет, когда завершается приложение в целом. Булева переменная speechOn управляет тем, слушает ли приложение какие-то команды, кроме команды на выход из программы.

Здесь идея в том, что консольное приложение не принимает набираемый с клавиатуры ввод, поэтому оно всегда слушает команды. Однако, если speechOn равна false, распознается и выполняется только команда на выход из программы; прочие команды распознаются, но игнорируются.

Метод Main начинается так:

try { ss.SetOutputToDefaultAudioDevice(); Console.WriteLine("\n(Speaking: I am awake)"); ss.Speak("I am awake");

Экземпляр объекта SpeechSynthesizer был создан при его объявлении. Использовать объект синтезатора довольно просто. Метод SetOutputToDefaultAudioDevice отправляет вывод на динамики, подключенные к вашему компьютеру (вывод можно отправлять и в файл). Метод Speak принимает строку, а затем произносит ее. Вот так все несложно.

Распознавание речи гораздо сложнее ее синтеза. Метод Main продолжает созданием объекта распознавателя:

CultureInfo ci = new CultureInfo("en-us"); sre = new SpeechRecognitionEngine(ci); sre.SetInputToDefaultAudioDevice(); sre.SpeechRecognized += sre_SpeechRecognized;

Сначала в объекте CultureInfo указывается распознаваемый язык, в данном случае United States English. Объект CultureInfo находится в пространстве имен Globalization, на которое мы сослались с помощью выражения using. Затем после вызова конструктора SpeechRecognitionEngine голосовой ввод назначается аудиоустройству по умолчанию - чаще всего микрофону. Заметьте, что в большинстве лэптопов есть встроенный микрофон, но на настольных компьютерах потребуется внешний микрофон (в наши дни он часто комбинируется с наушниками).

Ключевым методом для объекта распознавателя является обработчик событий SpeechRecognized. При использовании Visual Studio, если вы введете «sre.SpeechRecognized +=» и подождете долю секунды, IntelliSense автоматически закончит ваше выражение именем обработчика событий - sre_SpeechRecognized. Советую нажать клавишу Tab, чтобы согласиться с предложенным вариантом и использовать это имя по умолчанию.

Choices ch_Numbers = new Choices(); ch_Numbers.Add("1"); ch_Numbers.Add("2"); ch_Numbers.Add("3"); ch_Numbers.Add("4"); // с технической точки зрения, // это Add(new string { "4" }); GrammarBuilder gb_WhatIsXplusY = new GrammarBuilder(); gb_WhatIsXplusY.Append("What is"); gb_WhatIsXplusY.Append(ch_Numbers); gb_WhatIsXplusY.Append("plus"); gb_WhatIsXplusY.Append(ch_Numbers); Grammar g_WhatIsXplusY = new Grammar(gb_WhatIsXplusY);

Три основных объекта здесь - это набор Choices, шаблон GrammarBuilder и управляющий Grammar. Когда я создаю Grammar для распознавания, я начинаю с перечисления некоторых конкретных примеров того, что мне нужно распознавать. Скажем, «What is one plus two?» и «What is three plus four?».

Потом я определяю соответствующий универсальный шаблон, например «What is

В демонстрационной программе я ограничиваю для сложения от 1 до 4 и добавляю их как строки в набор Choices. Более эффективный подход:

string numbers = new string { "1", "2", "3", "4" }; Choices ch_Numbers = new Choices(numbers);

Я представляю вам менее эффективный подход к созданию набора Choices по двум причинам. Во-первых, добавление одной строки единовременно было единственным подходом, который я видел в других примерах с распознаванием речи. Во-вторых, вы могли подумать, что добавление одной строки единовременно вообще не должно работать; Visual Studio IntelliSense в реальном времени показывает, что одна из перегрузок Add принимает параметр типа params string phrases. Если вы не заметили ключевое слово params, то, возможно, сочли, что метод Add принимает только массивы строк, а одну строку - нет. Но это не так: он принимает и то, и другое. Я советую передавать массив.

Создание набора Choices из последовательных чисел в какой-то мере является особым случаем и дает возможность использовать программный подход наподобие:

string numbers = new string; for (int i = 0; i < 100; ++i) numbers[i] = i.ToString(); Choices ch_Numbers = new Choices(numbers);

После создания Choices для заполнения слотов GrammarBuilder демонстрационная программа создает GrammarBuilder, а затем управляющий Grammar:

GrammarBuilder gb_WhatIsXplusY = new GrammarBuilder(); gb_WhatIsXplusY.Append("What is"); gb_WhatIsXplusY.Append(ch_Numbers); gb_WhatIsXplusY.Append("plus"); gb_WhatIsXplusY.Append(ch_Numbers); Grammar g_WhatIsXplusY = new Grammar(gb_WhatIsXplusY);

Похожий шаблон демонстрационная программа использует при создании Grammar для команд, относящихся к старту и остановке:

Choices ch_StartStopCommands = new Choices(); ch_StartStopCommands.Add("speech on"); ch_StartStopCommands.Add("speech off"); ch_StartStopCommands.Add("klatu barada nikto"); GrammarBuilder gb_StartStop = new GrammarBuilder(); gb_StartStop.Append(ch_StartStopCommands); Grammar g_StartStop = new Grammar(gb_StartStop);

Грамматики можно определять очень гибко. Здесь команды «speech on», «speech off» и «klatu barada nikto» помещаются в одну грамматику, так как они логически связаны. Эти три команды можно было бы определить в трех разных грамматиках или поместить команды «speech on» и «speech off» в одну грамматику, а команду «klatu barada nikto» - во вторую.

Создав все объекты Grammar, вы помещаете их в распознаватель речи, и распознавание речи активируется:

sre.LoadGrammarAsync(g_StartStop); sre.LoadGrammarAsync(g_WhatIsXplusY); sre.RecognizeAsync(RecognizeMode.Multiple);

Аргумент RecognizeMode.Multiple необходим, когда у вас более одной грамматики, что будет во всех программах, кроме самых простейших. Метод Main завершается следующим образом:

While (done == false) { ; } Console.WriteLine("\nHit < enter > to close shell\n"); Console.ReadLine(); } catch (Exception ex) { Console.WriteLine(ex.Message); Console.ReadLine(); } } // Main

Странно выглядящий пустой цикл while позволяет сохранить работающей оболочку консольного приложения. Цикл будет завершен, когда булева переменная done уровня класса будет установлена в true обработчиком событий распознавания речи.

Обработка распознаваемой речи

Код обработки событий, связанных с распознаванием речи, начинается так:

static void sre_SpeechRecognized(object sender, SpeechRecognizedEventArgs e) { string txt = e.Result.Text; float confidence = e.Result.Confidence; Console.WriteLine("\nRecognized: " + txt); if (confidence < 0.60) return; ...

Распознанный текст хранится в свойстве Result.Text объекта SpeechRecognizedEventArgs. Кроме того, можно использовать набор Result.Words. Свойство Result.Confidence хранит значение от 0.0 до 1.0, которое является примерной оценкой того, насколько произнесенный текст соответствует любой из грамматик, связанных с распознавателем. Демонстрационная программа инструктирует обработчик событий игнорировать текст с низкой достоверностью (low confidence) распознанного текста.

Значения Confidence сильно зависят от сложности ваших грамматик, качества микрофона и других факторов. Например, если демонстрационной программе нужно распознавать лишь числа от 1 до 4, то значения достоверности на моем компьютере обычно находятся на уровне 0.75. Но, если грамматика должна распознавать числа от 1 до 100, значения достоверности падают приблизительно до 0.25. Если в двух словах, то обычно вы должны экспериментировать со значениями достоверности, чтобы добиться хороших результатов распознавания речи.

if (txt.IndexOf("speech on") >= 0) { Console.WriteLine("Speech is now ON"); speechOn = true; } if (txt.IndexOf("speech off") >= 0) { Console.WriteLine("Speech is now OFF"); speechOn = false; } if (speechOn == false) return;

Хотя, возможно, это не совсем очевидно поначалу, эта логика должна иметь смысл, если вдуматься в нее. Затем обрабатывается секретная команда выхода:

if (txt.IndexOf("klatu") >= 0 && txt.IndexOf("barada") >= 0) { ((SpeechRecognitionEngine)sender).RecognizeAsyncCancel(); done = true; Console.WriteLine("(Speaking: Farewell)"); ss.Speak("Farewell"); }

Заметьте, что механизм распознавания речи может на самом деле распознавать бессмысленные слова. Если объект Grammar содержит слова, отсутствующие во встроенном словаре этого объекта, Grammar пытается по возможности идентифицировать такие слова, используя семантическую эвристику, и обычно весьма успешно. Вот почему я использовал «klatu» вместо правильного «klaatu» (из одного старого научно-фантастического фильма).

Также заметьте, что вы не обязаны обрабатывать весь распознанный Grammar текст («klatu barada nikto») - нужно лишь иметь достаточно информации для уникальной идентификации грамматической фразы («klatu» и «barada»).

If (txt.IndexOf("What") >= 0 && txt.IndexOf("plus") >= 0) { string words = txt.Split(" "); int num1 = int.Parse(words); int num2 = int.Parse(words); int sum = num1 + num2; Console.WriteLine("(Speaking: " + words + " plus " + words + " equals " + sum + ")"); ss.SpeakAsync(words + " plus " + words + " equals " + sum); } } // sre_SpeechRecognized } // Program } // ns

Обратите внимание на то, что текст в Results.Text чувствителен к регистру букв («What» и «what»). Распознав фразу, ее можно разобрать на конкретные слова. В данном случае распознанный текст имеет форму «What is x plus y», поэтому «What» помещается в words, а два складываемых числа (как строки) сохраняются в words и words.

Установка библиотек

Объяснение демонстрационной программы подразумевает, что все необходимые речевые библиотеки установлены на вашем компьютере. Чтобы создавать и запускать демонстрационные программы, нужно установить четыре пакета: SDK (обеспечивает возможность создания демонстраций в Visual Studio), исполняющую среду (выполняет демонстрации после их создания), распознаваемый и синтезируемый (произносимый программой) языки.

Чтобы установить SDK, поищите в Интернете по словосочетанию «Speech Platform 11 SDK». Это приведет вас на нужную страницу в Microsoft Download Center (рис. 4 ). Щелкнув кнопку Download, вы увидите варианты, показанные на рис. 5 . SDK поставляется в 32- и 64-разрядной версиях. Я настоятельно советую использовать 32-разрядную версию независимо от разрядности вашей системы. 64-разрядная версия не взаимодействует с некоторыми приложениями.

Рис. 4. Основная страница установки SDK в Microsoft Download Center

Рис. 5. Установка Speech SDK

Вам не нужно ничего, кроме одного файла.msi под x86 (для 32-разрядных систем). Выбрав этот файл и щелкнув кнопку Next, вы можете запустить программу установки прямо отсюда. Речевые библиотеки не дают особой обратной связи насчет того, когда установка закончена, поэтому не ищите никаких сообщений об успешном завершении.

Рис. 6. Установка исполняющей среды

Крайне важно выбрать ту же версию платформы (в демонстрации - 11) и разрядность (32 или 64 ), что и у SDK. И вновь я настоятельно советую 32-разрядную версию, даже если вы работаете в 64-разрядной системе.

Затем можно установить распознаваемый язык (recognition language). Страница скачивания приведена на рис. 7 . В демонстрационной программе используется файл MSSpeech_SR_en-us_TELE.msi (English-U.S.). SR расшифровывается как распознавание речи (speech recognition), а TELE - как телефония; это означает, что распознаваемый язык предназначен для работы с низкокачественным аудиовходом, например от телефона или настольного микрофона.

Рис. 7. Установка распознаваемого языка

Наконец, вы можете установить язык и голос для синтеза речи. Страница скачивания приведена на рис. 8 . Демонстрационная программа использует файл MSSpeech_TTS_en-us_Helen.msi. TTS (text-to-speech), по сути, является синонимом синтеза речи (speech synthesis). Обратите внимание на два доступных голоса English, U.S. Есть и другие голоса English, но не U.S. Создание файлов языка синтеза - задача весьма сложная. Однако можно приобрести и установить другие голоса от множества компаний.

Рис. 8. Установка голоса и языка синтеза

Любопытно, что, хотя язык распознавания речи и голос/язык синтеза речи на самом деле являются совершенно разными вещами, оба пакета являются вариантами на одной странице скачивания. Download Center UI позволяет отметить как язык распознавания, так и язык синтеза, но попытка одновременной их установки оказалась для меня катастрофичной, поэтому я рекомендую устанавливать их по отдельности.

Сравнение Microsoft.Speech с System.Speech

Если вы новичок в распознавании и синтезе речи для Windows-приложений, вы можете легко запутаться в документации, потому что существует несколько речевых платформ. В частности, помимо библиотеки Microsoft.Speech.dll, используемой демонстрационными программами в этой статье, есть библиотека System.Speech.dll, являющаяся частью операционной системы Windows. Эти две библиотеки похожи в том смысле, что их API почти, но не полностью идентичны. Поэтому, если вы отыскиваете примеры обработки речи в Интернете и видите фрагменты кода, а не полные программы, то совершенно не очевидно, относится данный пример к System.Speech или Microsoft.Speech.

Если вы новичок в обработке речи, используйте для добавления поддержки речи в.NET-приложение библиотеку Microsoft.Speech, а не System.Speech.

Хотя обе библиотеки имеют общую основную кодовую базу и похожие API, они определенно разные. Неокторые ключевые различия суммированы в табл. 1 .

Табл. 1. Основные различия между Microsoft.Speech и System.Speech

System.Speech DLL - часть ОС, поэтому она установлена в каждой системе Windows. Microsoft.Speech DLL (и связанные с ней исполняющая среда и языки) нужно скачивать и устанавливать в систему. Распознавание с применением System.Speech обычно требует обучения под конкретного пользователя, когда пользователь начитывает какой-то текст, а система учится понимать произношение, свойственное этому пользователю. Распознавание с применением Microsoft.Speech работает сразу для любого пользователя. System.Speech может распознавать практически любые слова (это называет свободной диктовкой). Microsoft.Speech будет распознавать лишь те слова и фразы, которые имеются в объекте Grammar, определенном в программе.

Добавление поддержки распознавания речи к приложению Windows Forms

Процесс добавления поддержки распознавания и синтеза речи к приложению Windows Forms или WPF похож на таковой для консольного приложения. Чтобы создать демонстрационную программу, показанную на рис. 2 , я запустил Visual Studio, создал новое приложение C# Windows Forms и переименовал его в WinFormSpeech.

После загрузки кода шаблона в редактор я добавил ссылку на файл Microsoft.Speech.dll в окне Solution Explorer - так же, как я сделал это в консольной программе. В верхней части исходного кода я удалил ненужные выражения using, оставив только ссылки на пространства имен System, Data, Drawing и Forms. Затем добавил два выражения using для пространств имен Microsoft.Speech.Recognition и System.Globalization.

Демонстрация на основе Windows Forms не использует синтез речи, поэтому я не ссылаюсь на библиотеку Microsoft.Speech.Synthesis. Добавление синтеза речи в приложение Windows Forms осуществляется точно так же, как и в консольном приложении.

В Visual Studio в режиме проектирования я перетащил на Form элементы управления TextBox, CheckBox и ListBox. Дважды щелкнул CheckBox, и Visual Studio автоматически создал скелет метода-обработчика событий CheckChanged.

Вспомните, что демонстрационная консольная программа сразу же начинала прослушивать произносимые команды и продолжала делать это вплоть до своего завершения. Этот подход можно применить и в приложении Windows Forms, но вместо него я решил дать возможность пользователю включать и выключать распознавание речи с помощью элемента управления CheckBox (т. е. с помощью флажка).

Исходный код в файле Form1.cs демонстрационной программы, где определен частичный класс, представлен на рис. 9 . Объект механизма распознавания речи объявляется и создается как член Form. В конструкторе Form я подключаю обработчик событий SpeechRecognized, а затем создаю и загружаю два объекта Grammars:

public Form1() { InitializeComponent(); sre.SetInputToDefaultAudioDevice(); sre.SpeechRecognized += sre_SpeechRecognized; Grammar g_HelloGoodbye = GetHelloGoodbyeGrammar(); Grammar g_SetTextBox = GetTextBox1TextGrammar(); sre.LoadGrammarAsync(g_HelloGoodbye); sre.LoadGrammarAsync(g_SetTextBox); // sre.RecognizeAsync() находится // в обработчике события CheckBox }

Рис. 9. Добавление поддержки распознавания речи в Windows Forms

using System; using System.Data; using System.Drawing; using System.Windows.Forms; using Microsoft.Speech.Recognition; using System.Globalization; namespace WinFormSpeech { public partial class Form1: Form { static CultureInfo ci = new CultureInfo("en-us"); static SpeechRecognitionEngine sre = new SpeechRecognitionEngine(ci); public Form1() { InitializeComponent(); sre.SetInputToDefaultAudioDevice(); sre.SpeechRecognized += sre_SpeechRecognized; Grammar g_HelloGoodbye = GetHelloGoodbyeGrammar(); Grammar g_SetTextBox = GetTextBox1TextGrammar(); sre.LoadGrammarAsync(g_HelloGoodbye); sre.LoadGrammarAsync(g_SetTextBox); // sre.RecognizeAsync() находится // в обработчике события CheckBox } static Grammar GetHelloGoodbyeGrammar() { Choices ch_HelloGoodbye = new Choices(); ch_HelloGoodbye.Add("hello"); ch_HelloGoodbye.Add("goodbye"); GrammarBuilder gb_result = new GrammarBuilder(ch_HelloGoodbye); Grammar g_result = new Grammar(gb_result); return g_result; } static Grammar GetTextBox1TextGrammar() { Choices ch_Colors = new Choices(); ch_Colors.Add(new string { "red", "white", "blue" }); GrammarBuilder gb_result = new GrammarBuilder(); gb_result.Append("set text box 1"); gb_result.Append(ch_Colors); Grammar g_result = new Grammar(gb_result); return g_result; } private void checkBox1_CheckedChanged(object sender, EventArgs e) { if (checkBox1.Checked == true) sre.RecognizeAsync(RecognizeMode.Multiple); else if (checkBox1.Checked == false) // выключено sre.RecognizeAsyncCancel(); } void sre_SpeechRecognized(object sender, SpeechRecognizedEventArgs e) { string txt = e.Result.Text; float conf = e.Result.Confidence; if (conf < 0.65) return; this.Invoke(new MethodInvoker(() => { listBox1.Items.Add("I heard you say: " + txt); })); // специфика WinForm if (txt.IndexOf("text") >= 0 && txt.IndexOf("box") >= 0 && txt.IndexOf("1")>= 0) { string words = txt.Split(" "); this.Invoke(new MethodInvoker(() => { textBox1.Text = words; })); // специфика WinForm } } } // Form } // ns

Я мог бы создать два объекта Grammar напрямую, как в консольной программе, но вместо этого, что сделать код чуточку понятнее, определил два вспомогательных метода (GetHelloGoodbyeGrammar и GetTextBox1TextGrammar), которые и выполняют эту работу.

static Grammar GetTextBox1TextGrammar() { Choices ch_Colors = new Choices(); ch_Colors.Add(new string { "red", "white", "blue" }); GrammarBuilder gb_result = new GrammarBuilder(); gb_result.Append("set text box 1"); gb_result.Append(ch_Colors); Grammar g_result = new Grammar(gb_result); return g_result; }

Этот вспомогательный метод будет распознавать фразу «set text box 1 red». Однако пользователь не обязан точно проговаривать эту фразу. Например, он мог бы произнести: «Please set the text in text box 1 to red», и механизм распознавания речи все равно опознал бы фразу как «set text box 1 red» - пусть и с более низким значением достоверности, чем при точном совпадении с шаблоном Grammar. Другими словами, создавая объекты Grammar, вы не обязаны принимать во внимание все вариации фразы. Это радикально упрощает использование распознавания речи.

Обработчик событий для CheckBox определен так:

private void checkBox1_CheckedChanged(object sender, EventArgs e) { if (checkBox1.Checked == true) sre.RecognizeAsync(RecognizeMode.Multiple); else if (checkBox1.Checked == false) // выключено sre.RecognizeAsyncCancel(); }

Объект механизма распознавания речи, sre (speech recognition engine), всегда существует в течение всего срока жизни приложения Windows Forms. Этот объект активируется и деактивируется вызовами методов RecognizeAsync и RecognizeAsyncCancel, когда пользователь соответственно переключает CheckBox.

Определение обработчика событий SpeechRecognized начинается с:

void sre_SpeechRecognized(object sender, SpeechRecognizedEventArgs e) { string txt = e.Result.Text; float conf = e.Result.Confidence; if (conf < 0.65) return; ...

Помимо более-менее постоянно используемых свойств Result.Text и Result.Confidence, объект Result имеет несколько других полезных, но более сложных свойств, которые вы, возможно, захотите исследовать; например, Homophones и ReplacementWordUnits. Кроме того, механизм распознавания речи предоставляет несколько полезных событий вроде SpeechHypothesized.

this.Invoke((Action)(() => listBox1.Items.Add("I heard you say: " + txt)));

Теоретически, в этой ситуации использование делегата MethodInvoker чуть эффективнее, чем Action, так как MethodInvoker является частью пространства имен Windows.Forms, а значит, специфичен для приложений Windows Forms. Делегат Action более универсален. Этот пример показывает, что вы можете полностью манипулировать приложением Windows Forms через механизм распознавания речи - это невероятно мощная и полезная возможность.

Заключение

Информация, представленная в этой статье, должна дать вам возможность сразу же приступить к работе, если вы хотите исследовать синтез и распознавание речи в.NET-приложениях. Освоение самой технологии не составляет особого труда, как только вы минуете ухабы начального обучения и установки компонентов. Настоящая проблема в синтезе и распознавании речи - понимание того, когда это действительно полезно.

В случае консольных программ вы можете создавать интересные взаимные диалоги, где пользователь задает вопрос, а программа отвечает, в результате чего вы, по сути, получаете среду, подобную Cortana. Вы должны соблюдать некоторую осторожность, потому что, когда речь исходит из динамиков вашего компьютера, она будет подхвачена микрофоном и может быть распознана снова. Я сам попадал в довольно забавные ситуации, где задавал вопрос, приложение распознавало его и отвечало, но произносимый ответ инициировал следующее событие распознавания, и в итоге я получал смешной бесконечный речевой цикл.

Другое возможное применение речи в консольной программе - распознавание команд вроде «Launch Notepad» и «Launch Word». Иначе говоря, такая консольная программа может использоваться на вашем компьютере для выполнения действий, которые в ином случае потребовали бы множества манипуляций с клавиатурой и мышью.

Джеймс Маккафри (Dr. James McCaffrey) работает на Microsoft Research в Редмонде (штат Вашингтон). Принимал участие в создании нескольких продуктов Microsoft, в том числе Internet Explorer и Bing. С ним можно связаться по адресу [email protected] .

Выражаю благодарность за рецензирование статьи экспертам Microsoft Research Робу Грюну (Rob Gruen), Марку Маррону (Mark Marron) и Кертису фон Ве (Curtis von Veh).